Irgendwie steht heute doch immer wieder die Überlegung – Frage nach einem “Home Storage” im Raum. Der Einfachste Ansatz ist eine QNAP zu kaufen und einen Stapel Scheine auf den Tisch zu legen und gut ist.

Dafür bin ich dann aber im ersten Wurf zu geizig, auch wenn es zweifellos eine empfehlenswerte Variante wäre. Andere Storages sind nicht so viel billiger wie sie weniger können, da steht das Anspruchsdenken im Weg.

Was tun? Selber bauen ? Ohne das Rad neu zu erfinden ?

Vor einiger Zeit habe ich mir einen “Fuijtsu Scaleo Home Server 1900” auf ebay geschossen. Nackt, beziehungsweise nur mit dem Standard 512MB Speicherriegel, aber ohne Platten. Da man diese ja ohnehin meist nachkaufen muss hat mich das nicht sonderlich gestört. Was man wissen darf ist, dass der Homeserver ein OEM Produkt von Intel ist, des “SS4200”

Was fehlt ist ein DOM -Disk on Module – wie es eigentlich hätte anwesend sein sollen, da zumindest Intel im Standard ein EMC Betriebssystem (modifiziertes Linux) mit lieferte, an das verschiedene Backup Agenten anschlossen. Da meinen Recherchen nach weder bei Intel noch bei FSC die Platten default-mäßig mit dabei waren – das System ist “End of Sale” – muss ein DOM dagewesen sein. Einen anderen Flash Speicher konnte ich bisher nicht identifizieren. Auf Ebay finden sich schnell, wenn auch nicht super günstig DOMs in 4GB,8GB oder 16GB, in Industriequalität.

Platten hatte ich ohnehin vor in SATA – Serverqualität zu bestellen. An dieser Stelle hat Western Digital eine erfreuliche Neuerung mit den “WD red” ins spiel gebracht von welchen ich vier Stück a 2TB geordert habe.

Alles in allem komme ich so mit einem Invest von knapp 700,- EUR auf ein 8 bruttoTB NAS. Eine Größenordnung, wofür es anderenorts gerade einmal ein Gehäuse gibt.

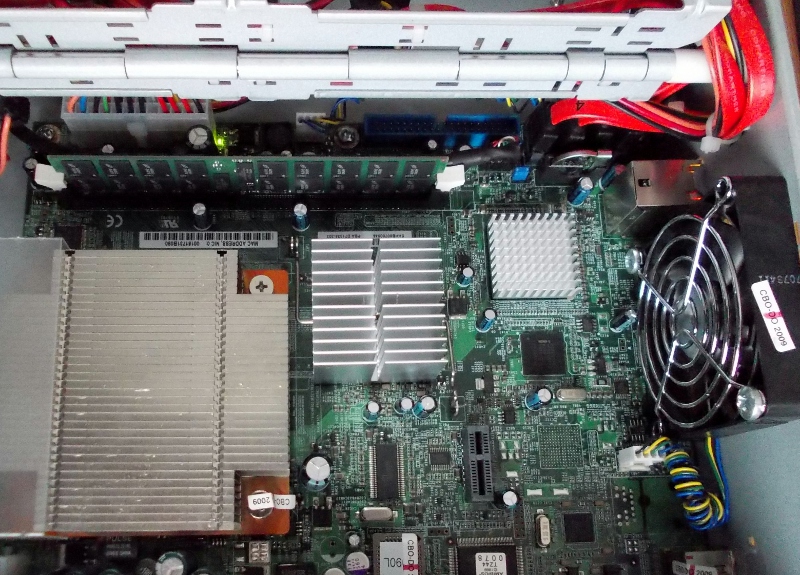

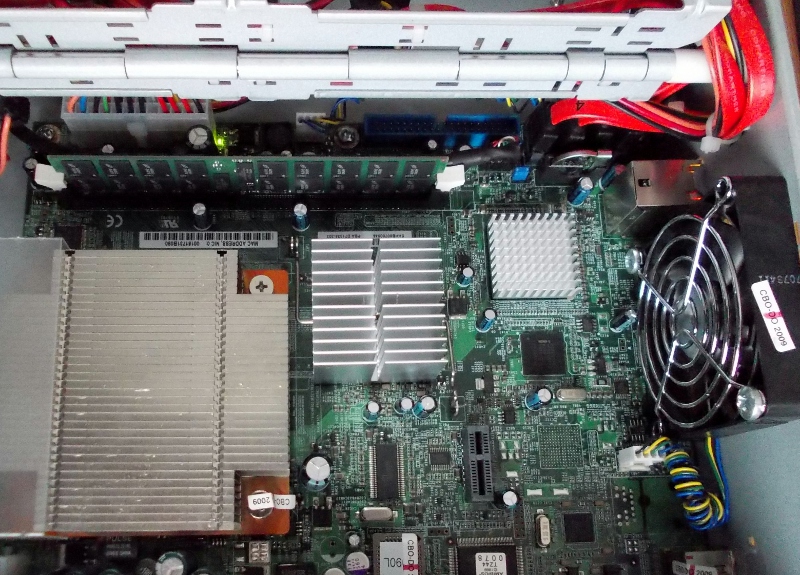

Pro: Die mechanische Verarbeitung der Box ist sehr gut. Mir gefällt vor allen Dingen die Mimik mit den beweglich aufgehängten Plattenrahmen, die den Zugriff Werkzeug-los bis auf Board und Netzteil erlauben. Das Board hat eine Low Voltage Celeron Basis und ist Intel Standard. Die Treiberthemen bei den möglichen Betriebssystemen und Installationsmöglichkeiten sind ohne großen Aufwand lösbar. Die Systemressourcen auch mit den 2GB Hauptspeicher erlauben eine variablere Nutzung. Die Verwendeten DOMs und WDreds versprechen eine sehr robuste lange Lebensdauer, welche zumindest eine Reparatur oder Systemwiederherstellung zu lässt.

Con: Ein Standard Intel Board braucht auch in Low Voltage etwas mehr Strom als derzeit am Markt befindliche NAS Systeme auf ARM oder Atom Basis. Beim 24×7 Betrieb erwarte ich hier einige Nachteile. Die Lüfter sind recht groß und leider auch laut.

Mitigation: Mit dem Betriebssystem auf dem DOM und Standard ACPI können sich die Platten effektiv schlafen legen. Wenn sich die Lärmentwicklung als störend erweist muss ich mal nach alternativen Leisetretern ausschau halten, bzw. die üblichen Lüfter-Geräusch-Reduktions-Tricks der Reihe nach ausprobieren.

Mein Fazit bis hierher, die Kosten und die Flexibilität wiegen die beiden akuten Nachteile mehr als auf.

Im Snapshot des Board sieht man ebenfalls den PCIx-1 Slot der für Diagnosezwecke mit an Board ist. Da ein vorbetanktes Speichermedium fehlt, eine Installation blind via USB-Stick oder USB-CDROM eher mühsam erscheint, bietet es sich an hier temporär eine Grafikkarte zu stecken. An den vier vorhandenen USB Buchsen kann man dann noch immer Maus und Tastatur anschliessen.

Als Betriebssystem bietet sich neben den typischen Verdächtigen FreeNAS, Openfiler oder Nexenta noch einiges mehr an. Letzteres reizt mich insbesondere durch die Verwendung von ZFS, was mir hinsichtlich Migration und Zuverlässigkeit wirklich sehr zusagt. Für 100% freie Varianten steht Open Indiana mit den Comstar Erweiterungen zur Verfügung.

Hier stellt sich jedoch die Frage nach der eigentlich gewünschten Verwendung und die geht mitlerweile über die reine Speicherbox hinaus. Eine zentrale Medienablage für unsere gesammelten Fotos und unsere gerippten Backups wäre sehr wünschenswert, zumal auch zunehmend smarte Androiden und nicht zuletzt eine XBox 360 hier den universellen Zugriff erlauben.

Auf der Open Source Schiene bietet sich das Open Media Vault an. Aber die XBox Anbindung bereitet mir hier Schmerzen. Irgendwie bin ich noch nicht auf das richtige Forum gestossen, das mir hier die Sorgen nimmt. Und so bleibt als letzte Line of Defense Windows Home Server 2011 mit einem Windows Media Center. Das funktioniert auf jeden Fall und ist auch vergleichsweise erschwinglich. Allerdings ist man dann wieder closed fest genagelt 🙁

Intel stellt erfreulicherweise noch immer ein Support Dokument für die Windows Home Server Installation zur Verfügung. Das covert zumindest die Installation vom 2008er Server. Die Treiberthemen sollten mit 2011 erledigt sein.

Fazit gibt es noch keins, ich werde die ein oder ander Variante in den nächsten Wochen durchprobieren, bevor ich der Kiste alle meine Daten anvertraue.

kyp. F.

p.s. Auch wenn die Basis schon eine Weile auf dem Buckel hat, erscheint sie mir auch nach gründlicher Betrachtung der Alternativen noch immer sehr interessant.